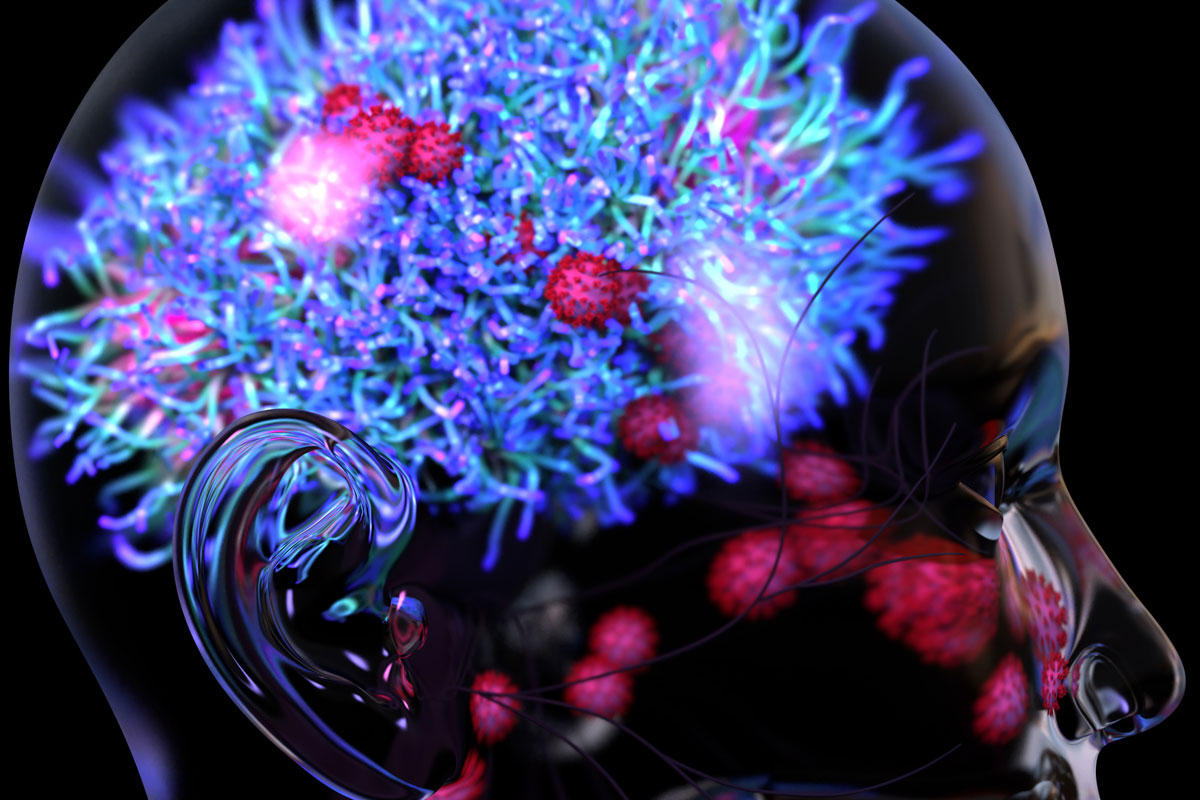

In den letzten Jahren hat die künstliche Intelligenz – oder KI – begonnen, die Welt, wie wir sie kennen, zu revolutionieren: Einige Menschen bitten nun KI-basierte Chatbots, Aufsätze zu schreiben und Dokumente zusammenzufassen, andere nutzen KI-gestützte virtuelle Assistenten, um Nachrichten zu versenden und Smart-Home-Geräte zu steuern, wieder andere setzen die Technologie für die Entdeckung und Entwicklung von Medikamenten ein. Der Experte für computergestützte Neurowissenschaften Friedemann Zenke nutzt KI, um die Funktionsweise des Gehirns zu erforschen.

In einer Studie untersuchten Forschende unter der Leitung von Zenke – einem Forschungsgruppenleiter am FMI – wie bestimmte Gruppen von Neuronen ihre Verbindungen als Reaktion auf äußere Reize anpassen. Die Arbeit könnte Neurowissenschaftler:innen helfen zu verstehen, wie sensorische neuronale Netze, die Informationen der Umwelt verarbeiten, die Außenwelt wahrnehmen.

Zenke und seine Gruppe verwenden mathematische Werkzeuge und Theorien, um zu untersuchen, wie Gruppen von Neuronen im Gehirn beim Lernen und Abspeichern von Erinnerungen zusammenarbeiten. Durch die Entwicklung von Ansätzen, die der Komplexität des menschlichen Gehirns gerecht werden, erstellt Zenkes Team KI-basierte Modelle von neuronalen Netzwerken, die uns nützliche Informationen über das reale Organ liefern können.

Verständnis für Vorgänge im Körper erlangen

„Jeder Mensch hat ein Gehirn, aber wir verstehen nicht wirklich, wie es funktioniert“, sagt Zenke. „Unser Ziel ist es, ein gewisses Verständnis dafür zu erlangen, denn bevor wir uns mit Krankheiten befassen können, müssen wir verstehen, wie das gesunde System funktioniert.“

Zenke hatte schon jung eine Vorstellung davon, wie eine wissenschaftliche Laufbahn aussehen würde. Sein Vater, ein Zellbiologe, machte ihn schon früh mit der Umgebung eines biomedizinischen Labors vertraut. An den Wochenenden und in den Schulferien begleitete Zenke seinen Vater bei der Arbeit. „Ich erinnere mich gerne daran, wie ich als Kind meinen Finger in den Vortex steckte“, sagt Zenke. „Aber schon damals haben mich die Computer im Labor am meisten fasziniert.“

Zenke entschied sich schließlich für ein Physikstudium, und Ende 2000 begann er, in dem Zweig der Physik, der sich mit den grundlegenden Bausteinen der Materie beschäftigt, zu arbeiten.

Erste Forschung zu Neuronen

Obwohl Zenke das Gebiet faszinierend fand, waren die Zeiträume der Experimente zu lang. Er hoffte, dass seine Forschung eine unmittelbarere Wirkung haben würde. Er erkannte, dass das aufblühende Gebiet der computergestützte Neurowissenschaft unser Verständnis des Gehirns mit rasanter Geschwindigkeit vorantreibt. „Das war es, was mich zum Wechsel bewogen hat“, sagt er.

Ein weiterer Aspekt, der Zenke zu den Neurowissenschaften geführt hat, ist ihre Komplexität. „Es ist wahrscheinlich eines der kompliziertesten Forschungsthemen, die es derzeit gibt, und es erfordert einen interdisziplinären Ansatz.“

Nachdem er seine eigene Gruppe am FMI gegründet hatte, begann Zenke zu untersuchen, wie einzelne Neuronen zur Bildung von Erinnerungen beitragen – ein Prozess, der eine wichtige Rolle beim Lernen, bei der Problemlösung, und bei der persönlichen Identität spielt.

Wenn wir zum Beispiel jemanden zum ersten Mal sehen, aktiviert das Gehirn bestimmte Gruppen von Neuronen. Dies führt zu einem einzigartigen Muster neuronaler Aktivität, das hilft, eine Erinnerung zu schaffen. Doch die einzigen Informationen, die ein einzelnes Neuron über die Außenwelt hat, sind elektrische Impulse, die es von anderen Neuronen empfängt und an diese weiterleitet. „Wie trägt ein einzelnes Neuron zu dieser Berechnung des Gedächtnisses und der Erkennung von zum Beispiel einer Person bei?“, fragt sich Zenke.

Simulation von Neuronen-Gruppen am Computer

Die Zenke Gruppe geht dieser Frage mit verschiedenen Ansätzen aus der Mathematik, Informatik und Physik nach. Erinnerungen werden durch Veränderungen in Gruppen von Neuronen und den Verbindungen – oder Synapsen – zwischen ihnen gebildet. Die Forschenden simulieren also diese Gruppen von Neuronen – oder neuronale Netzwerke – am Computer.

Dann nutzen sie Ansätze aus der Physik, um ein theoretisches Verständnis der Vorgänge in den Netzwerken zu erhalten. „Die Physik bringt die Kraft der Abstraktion mit – sie versucht, ein Problem auf das absolute Minimum zu reduzieren, auf die einfachsten Teile, die man verstehen kann“, sagt Zenke.

Maschinelles Lernen unterstützt die Forschung

Im Gehirn arbeiten jedoch Hunderte oder Tausende von Neuronen zusammen, um Erinnerungen zu bilden und manchmal reichen rein analytische Ansätze nicht aus, um zu verstehen, wie diese Zellen Informationen berechnen. In diesem Fall wenden sich die Forschenden Methoden des maschinellen Lernens zu, um groß angelegte Simulationen zu erstellen.

Eine solche Technologie ist das Deep Learning, das bei vielen neueren Fortschritten im Bereich der KI, einschließlich des autonomen Fahrens, eingesetzt wird. Deep Learning basiert auf neuronalen Netzwerken, die die Informationsverarbeitung des menschlichen Gehirns nachahmen und so aus großen Datenmengen „lernen“ können. „Ein neuronales Netzwerk an sich macht nichts Sinnvolles. Es fängt erst an, etwas Sinnvolles zu tun, wenn man es mit einem Algorithmus trainiert“, sagt Zenke.

Wenn der Algorithmus das neuronale Netzwerk mit Daten „füttert“, verändern sich die Verbindungen innerhalb des Netzwerkes, was zu einem komplexeren Modell führt. Mit solchen Computermodellen neuronaler Netzwerke können Neurowissenschaftler Fragen zur Funktionsweise des Gehirns erforschen, ähnlich wie Biologen es mit lebenden Tieren tun.

Neuronen aktiv oder stumm schalten

Wenn es den Forschenden gelingt, Modelle für neuronale Netzwerke zu entwerfen, die ähnlich funktionieren wie das Gehirn, könnte dies eine Erklärung dafür liefern, wie das reale Organ Informationen berechnet und Erinnerungen speichert, sagt Zenke. In den letzten Jahren hat sein Team mathematische Beschreibungen dafür entwickelt, wie sich Synapsen durch Erfahrung verändern.

Die Forschenden trainierten ein pulsgekoppeltes neuronales Netzwerk, das die elektrischen Spikes nachahmt, mit denen Neuronen miteinander kommunizieren. Sie stellten fest, dass dieses Netzwerk einige bemerkenswerte Ähnlichkeiten mit der Funktionsweise echter Gehirne aufweist.

So haben Experimente an Tiermodellen gezeigt, dass das richtige Gleichgewicht zwischen erregenden und hemmenden elektrischen Signalen es den Neuronen ermöglicht, unter bestimmten Umständen aktiv und unter anderen stumm gestalten zu sein.

Als Zenkes Team das pulsgekoppelte neuronale Netzwerk darauf trainierte, eine bestimmte Aufgabe auszuführen – zum Beispiel gesprochene Wörter aus einem Satz zu erkennen – entwickelten die künstlichen Neuronen in dem Netzwerk ein Gleichgewicht zwischen erregenden und hemmenden synaptischen Strömen, ohne dass dies explizit vom Modell verlangt wurde. „Hier schließt sich der Kreis: Das Modell erreicht ein Gleichgewicht, das wir auch in der Biologie finden können“, sagt er.

Sensorische Netzwerke untersucht

In ihrer jüngsten Studie untersuchten Zenke und sein Team, wie sensorische Netzwerke die Außenwelt in neuronaler Aktivität darstellen. Sensorische Netzwerke im Gehirn aktualisieren ihre Verbindungen in der Regel als Reaktion auf äußere Reize ohne initiales Verständnis, was diese Reize verkörpern. Bei künstlichen neuronalen Netzwerken ist das anders.

Ihre Lernalgorithmen werden mit spezifischen Daten, deren Inhalt oder Bedeutung bekannt ist, gefüttert. Die Forschenden fanden eine einfache Lösung für dieses Problem, indem sie die Lernregeln abänderten, die helfen die Bedeutung zukünftiger Reize zu erraten oder vorherzusagen. Bisherige Lernregeln wurden aus experimentellen Daten abgeleitet, aber ihnen fehlte ein grundlegender Aspekt: die Vorhersage zukünftiger Ereignisse. Also entwickelte Zenkes Team Lernregeln, die versuchen, zukünftige sensorische Eingaben jedes Neurons vorherzusagen.

„Das ist die Schlüsselkomponente, die alles zu verändern scheint, was diese Netzwerke tun können“, sagt Zenke. Die Erkenntnisse könnten Neurowissenschaftlern helfen, viele experimentelle Ergebnisse aus Tiermodellen zu verstehen.

KI-gestützte Modelle

Für die Zukunft plant Zenke, größere Netzwerke aus zusammenhängenden neuronalen Schaltkreisen zu schaffen – ein Konstruktionsprinzip, das vom Gehirn verwendet wird –, um zu untersuchen, wie das reale Organ die Außenwelt modelliert, zum Beispiel um Entscheidungen zu treffen oder die Handlungen anderer Menschen zu bewerten.

Durch die Kombination neuronaler Schaltkreise zu großen Netzwerken erhalten die künstlichen Modelle eine rudimentäre Form des Verhaltens, die es Zenke ermöglichen, diese mit experimentellen Ergebnissen anderer Forschenden zu vergleichen, einschließlich der Neurobiologen am FMI, die mit Tiermodellen arbeiten. Die von den KI-gestützten Modellen erstellten Vorhersagen könnten auch an lebenden Tieren getestet werden, was den Neurowissenschaftlern zusätzliche Werkzeuge für die Erforschung der Funktionsweise des Gehirns bieten könnte und Durchbrüche fördern würde, die sonst Jahrzehnte dauern würden.

„Am FMI und in Basel haben wir eine exzellente Gemeinschaft von Neurowissenschaftlerinnen und -wissenschaftlern, die eine lebendige, kollaborative Atmosphäre schaffen“, sagt Zenke. „Es ist ein fantastischer Ort, um diese Art von Forschung zu betreiben.“

Quelle: idw – Informationsdienst Wissenschaft

Originalpublikation: Halvagal, M.S., Zenke, F.; The combination of Hebbian and predictive plasticity learns invariant object representations in deep sensory networks; Nat Neurosci, 2023; doi: 10.1038/s41593-023-01460-y